Les dirigeants sont constamment amenés à prendre des décisions. Chacune d’entre elles, même la plus anodine, a des répercussions, infléchissant des trajectoires tant collectives qu’individuelles. Puisque l’acte de décider est si crucial, il incombe au décideur de prendre la meilleure décision possible. Nous aspirons à bien décider en toutes circonstances : au bureau, à la maison, en équipe ou seul. Mais qu’est-ce qu’une bonne décision au juste ?

Pour nous, une bonne décision est avant tout rationnelle : instruite, cohérente, objectivée et si possible formalisée et quantifiée. Elle maximise l’objectif qui lui est assigné, traite le plus d’informations possibles, et tient compte des contraintes de la situation. Cette rationalité nous rassure à la fois sur notre pertinence (nous avons été juste et au bon endroit) mais elle est aussi gage de l’acceptabilité de notre décision par les autres. La rationalité est notre langage commun : plus une décision est rationnelle, plus elle a du sens pour les autres, moins elle suscite du rejet.

La décision parfaite

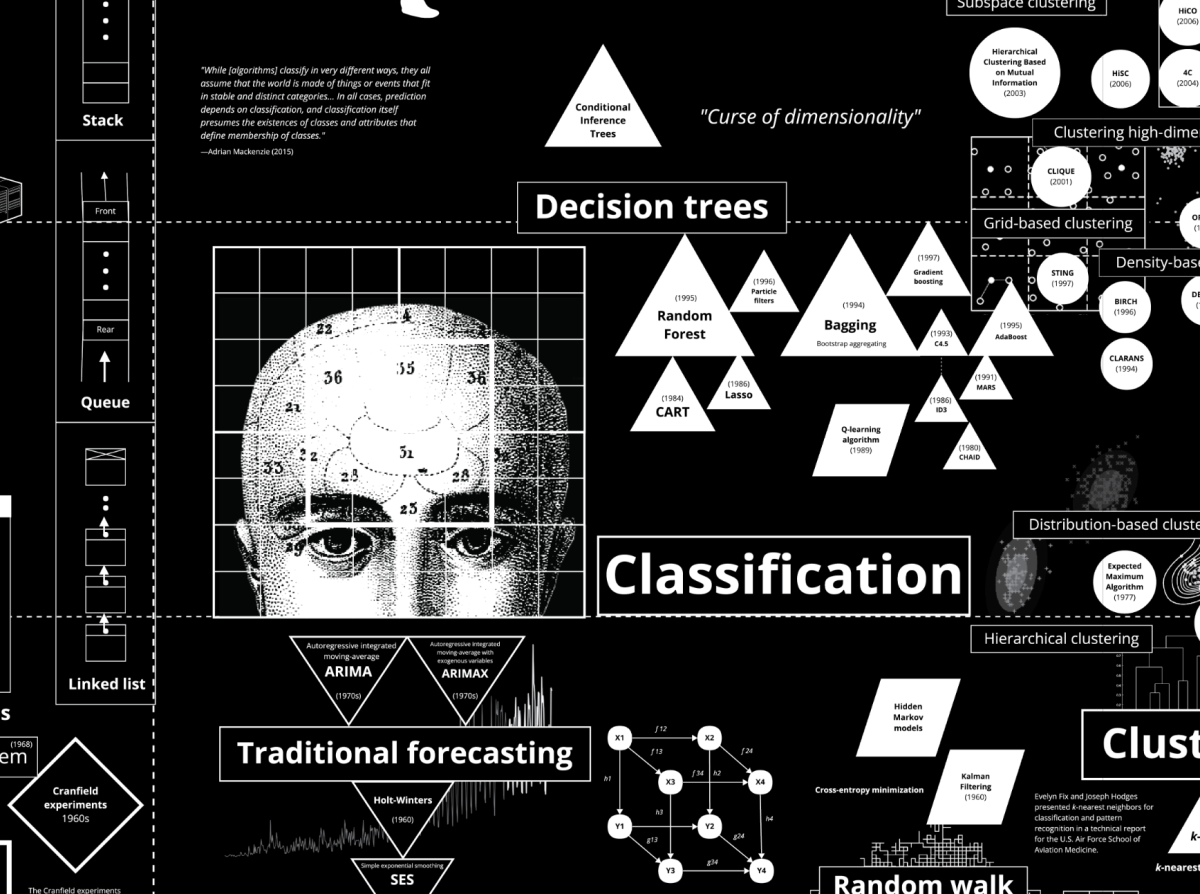

Toute bonne décision est précédée d’une phase d’analyse rigoureuse qui porte sur deux types de données : des données tangibles, relatives au passé et au présent (relevant de l’analyse statistique), et des données prospectives, concernant un avenir incertain et non encore advenu (relevant de l’analyse des probabilités). Il n’est pas surprenant que les sciences de la décision, regroupées au sein de la théorie de la décision, aient très tôt eu recours aux mathématiques pour édifier le langage rationnel des choix.

“Un des objets de la théorie de la décision est de donner les moyens de construire des descriptions quantifiées des problèmes, ainsi que des critères, qui permettent d’y apporter des solutions. La description des problèmes de décision utilise le langage mathématique parce que c’est un langage universel, d’une part, et, d’autre part, parce qu’il permet d’utiliser de puissants outils d’analyse” (Robert Kast, La théorie de la décision, 2002).

La phase d’analyse doit donc embrasser le plus grand nombre de données possible en réalisant les “bonnes” inférences. C’est là que réside la légitimité de la décision : elle est proportionnelle à la quantité de données analysées “correctement” en amont. L’IA représente à cet égard une opportunité majeure. Là où nos capacités cognitives atteignent leurs limites, elle semble n’en connaître aucune. Son fonctionnement, algorithmique et utilitariste, ouvre donc la voie à des décisions parfaitement logiques et objectives, du moins qualitativement supérieures à celles que l’esprit humain pourrait produire.

Inscrire les décisions dans le monde réel

La réalité s’avère plus nuancée. Malgré sa puissance, le système présente de nombreuses failles techniques : hallucinations, data poisoning, ou dysfonctionnements inexpliqués, susceptibles de fausser ses analyses. Mais surtout — et cela peut paraître paradoxal — une décision parfaitement logique en termes d’inférences n’est pas nécessairement une bonne décision.

“Les algorithmes qui font passer d’un état au suivant — c’est-à-dire qui réalisent une inférence — doivent donc respecter les normes logiques : ils ne doivent réaliser que de “bonnes” inférences, à savoir qui préservent la vérité. Mais cela ne suffit pas à atteindre le but fixé” (Andler, 2022).

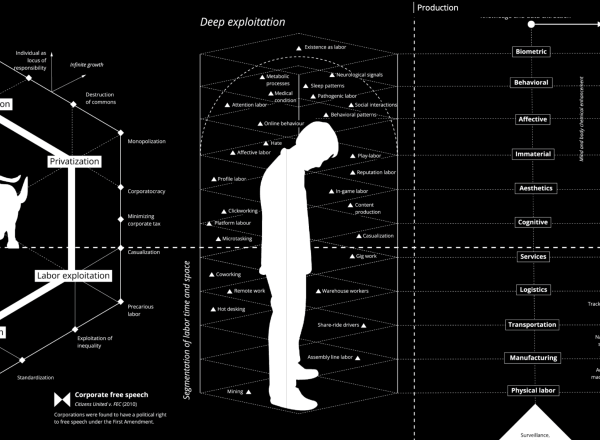

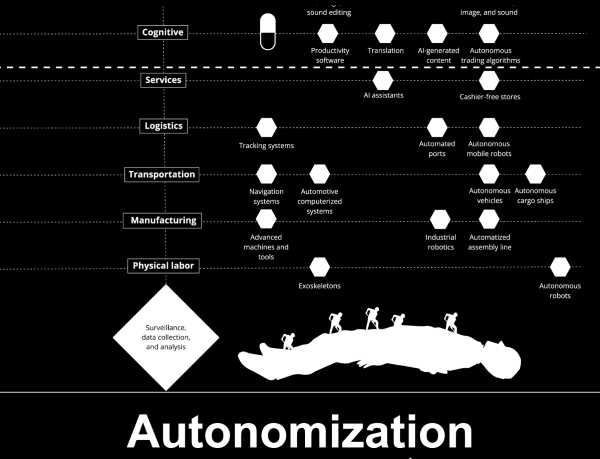

En effet, l’accumulation quantitative de bonnes inférences ne suffit pas à atteindre un objectif qualitativement complexe. Autrement dit, l’IA excelle dans les situations où l’objectif à atteindre est relativement simple. Par exemple, à partir de données financières, l’IA sait proposer des optimisations de coûts si son unique mission est de maximiser l’efficience. Toutefois, la situation se complexifie lorsque l’objectif intègre les dimensions plus subtiles du monde réel. L’IA sera d’une utilité limitée si l’objectif formel d’optimisation des coûts doit être concilié avec une multitude d’autres buts, plus ou moins formels et tangibles, tels que le renforcement de la marque employeur, l’engagement des collaborateurs, ou des positionnements éthiques en faveur du maintien de l’emploi.

Une longueur d’avance sur la machine

L’IA est un outil d’analyse de données formelles formidable, mais elle semble dénuée d’intelligence politique. Elle échoue, par exemple, à saisir l’atmosphère d’une équipe, nos sources d’anxiété et de joie, nos sensibilités, nos besoins ou nos lignes morales, autant de données plus ou moins conscientisées. Comme le rappelle Antoine Naulet, chef militaire : “L’IA déchire le voile de l’incertitude. Mais elle ne le lève pas” (Naulet, 2019).

Bien utiliser l’IA implique donc d’élucider nos objectifs et nos intentions individuelles et collectives pour cultiver la capacité critique permettant de juger ses résultats. Ce constat sur notre culture permettra de définir ce que nous voulons et ce qui est essentiel pour nous, afin de conserver une longueur d’avance sur la machine : “La culture, c’est la profondeur qui permet l’appréhension éthique garante du temps long ; l’IA peut optimiser nos gains tout en détruisant la planète, seul l’humain peut et doit avoir une vue au-delà de ses objectifs” (Naulet, 2019).

Ne cédons pas aux sirènes de la rationalité de l’IA. Lui échappent toutes nos décisions en apparence irrationnelles mais qui s’avèrent bonnes pour nous, pour les autres, pour la société. Nous décidons parfois de perdre aujourd’hui sans savoir ce que nous gagnerons demain parce que nous savons que notre monde est infiniment complexe, parce que vivant et imprévisible et qu’aucune machine ne peut le “calculer”. Dans ces temps-là, c’est la communauté politique et le principe même de la confiance qui la régit qui prend le dessus. En période d’incertitude, en plus de l’IA, peut-être faut-il aussi s’armer de confiance pour prendre les bonnes décisions ?

Illustration :Calculating Empires: A Genealogy of Technology and Power Since 1500 By Kate Crawford and Vladan Joler (2023)